Das mit Abstand prominenteste und reichweitenstärkste „Opfer“ von Sperren auf Sozialen Medien ist zweifellos Donald Trump. Mit seiner unverhohlenen Unterstützung des Sturms aufs Washingtoner Kapitol ist er einen Schritt zu weit gegangen. Die Löschung seines Twitter-Accounts mit mehr als 88 Millionen Follower*innen war ein Einschnitt, weitere Plattformen wie Facebook mit Instagram, YouTube, Snapchat, TikTok u.a. (1) zogen mit Sperren nach. Eine berechtigte Kritik lautet, dass die Sperren erst dann erfolgt sind, als Trump als US-Präsident de facto Geschichte war.

Nun hat es auch die FPÖ, genauer gesagt, das Video Rede des FPÖ-Klubobmanns Herbert Kickl erwischt. Sie wurde von YouTube mit der Begründung gelöscht, Kickl habe medizinische Falschnachrichten verbreitet. Damit lag YouTube eindeutig richtig. Neben Diffamierungsorgien in Richtung Regierung und SPÖ, fütterte Kickl das impfkritische und verschwörungsideologisch getrimmte Klientel mit allerlei Falschbehauptungen: Die Covid-Impfungen seien ein „Feldversuch der Pharmaindustrie“ „ein Massenexperiment (…), weil die Erprobung fehlt“ (die zigtausend Tests, die vor der Freigabe der Impfung durchgeführt wurden, ignoriert Kickl wohl ganz bewusst), Kinder würden beim Infektionsgeschehen keine Rolle spielen (das Gegenteil beweisen inzwischen mehrere Studien, darunter eine aus Österreich), die neuartigen mRNA-Impfungen könnten die menschliche DNA beeinflussen (was wissenschaftlich ebenfalls hinlänglich widerlegt wurde) und als Spitze eine Bemerkung, die er bereits im ORF-Talk „Im Zentrum“ – de facto unwidersprochen – von sich geben konnte: Es gäbe laut der Weltgesundheitsorganisation WHO keine Daten, die belegen würden, dass die nunmehr zur Anwendung freigegebenen Impfungen tatsächlich vor Covid schützen. Im Gegenteil: Die Appelle der WHO gehen im Moment in die Richtung, die beschränkt verfügbaren Impfstoffe gerechter zu verteilen, also auch auf benachteiligte Länder und Bevölkerungsgruppen. Das würde sie kaum tun, wenn die Wirksamkeit nicht belegt wäre.

Was das Deplatforming angeht, steht es Demokratien nicht gut zu Gesicht, dass eine kleine Gruppe von Unternehmenschefs Entscheidungen solcher Tragweite trifft. Selbst, wenn das Ergebnis richtig ist für die Demokratie. (netzpolitik.org)

Der Einwand, dass private Unternehmen wie Google, Facebook & Co darüber entscheiden, was öffentlich gemacht werden kann und was nicht, ist durchaus berechtigt, dass das „richtige“ Ergebnis für die Demokratie im Fall der großflächigen Sperren („Deplatforming“) neonazistischer und rechtsextremer Personen und Gruppierungen rauskommt, zeigt die Studie „Hate not found?! Das Deplatforming der extremen Rechten und seine Folgen“ des Instituts für Demokratie und Zivilgesellschaft Jena. Die Ergebnisse zusammenfassend:

Das Deplatforming zentraler rechtsextremer Akteure schränkt deren Mobilisierungskraft deutlich ein und nimmt ihnen eine zentrale Ressource, auf die ihre Inszenierungen abzielen: Aufmerksamkeit. In dieser Hinsicht lässt sich eindeutig sagen: Deplatforming wirkt.

Repressive Plattformpolitiken treffen Hassakteure nicht mehr überraschend oder unvorbereitet. Im Gegenteil: Es bildeten sich innovative Muster des Umgangs heraus, die Handlungsfähigkeit signalisieren. Dazu gehören: semantische Mimikry-Taktiken, (Audio-)Visualisierung der Propaganda, Schaffung von Fake-Accounts, Einsatz von Proxies, Ausweichen auf Alternativplattformen sowie Aufbau eigener digitaler Infrastrukturen.

Alternative Netzwerke werden genutzt, um Inhalte von gelöschten Akteuren wieder gezielt auf den großen Plattformen zu verbreiten. So navigieren Hassakteure ihre Follower*innen und Inhalte plattformübergreifend.

Telegram hat sich zum zentralen Medium unter Hassakteuren entwickelt: 96% aller von uns untersuchten Hassakteure haben hier (hyper-)aktive Kanäle. Die meisten verstehen Telegram als ihre kommunikative Basis. Was dieses hybride Medium besonders macht: Es gibt so gut wie keine Moderation der Betreiber, Push-Nachrichten auf das Handydisplay wirken unmittelbarer und es kann leicht zwischen privater Messengerfunktion und öffentlicher Kanalfunktion gewechselt werden.

Der Rückzug auf Alternativplattformen kann die Löschung aus dem digitalen Mainstream nicht ausgleichen. Abgesehen von Telegram haben sich keine stabilen Ausweichforen etabliert. Auf den bestehenden Alternativplattformen können rechtsextreme Ideen nicht effektiv zirkulieren, da sie kaum von Nutzer*innen aus dem deutschsprachigen Kontext frequentiert werden.

Um nicht-intendierte Folgen des Deplatformings zu vermeiden, zum Beispiel die Steigerung von Aufmerksamkeit und der Bedeutung der Akteure, müssen Maßnahmen besser abgestimmt, deutlicher kommuniziert und unabhängig von politischen Kräfteverhältnissen durchgesetzt werden.

Das IDZ zeigt u.a. am Beispiel des Identitären-Chefs Martin Sellner wie sich seine Reichweiten nach den Sperren auf Twitter und YouTube über andere Kanäle entwickelt haben.

Im Juli 2020 war die rechtsextreme Hassgruppe erneut von einer Welle von Sperrungen betroffen: auf Twitter (10.07.2020), YouTube (15.07.2020) und TikTok (16.07.2020). Auch Martin Sellners Webhoster kündigte seine Dienstleistung auf. Sellners Website musste bei einem neuen Betreiber unterkommen. Seitdem weicht die Gruppe vermehrt auf Alternativplattformen aus – allerdings findet die Öffentlichkeitsarbeit der Rechtsextremen dadurch vor deutlich kleinerem Publikum statt. Nachdem allein Martin Sellner auf YouTube und Twitter noch im Juli 2020 etwa 180.000 Follower*innen erreichte, ist das Publikum nun deutlich geschrumpft. Den rund 144.000 Abonnent*innen auf Sellners gesperrtem YouTube-Kanal stehen etwa 16.900 Abonnent*innen auf der alternativen Videoplattform BitChute und 6.300 Abonnent*innen auf der Streaming-Plattform DLive gegenüber. (Studie IDZ, S. 36) (2)

Neben der deutlich verringerten Reichweite geht es auch um vermutlich beträchtliche monetäre Folgen. Der Spendenfluss wird geringer sein, wenn nur mehr bei einem Bruchteil der vorhergehenden „Fans“ gekeilt werden kann.

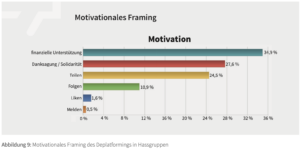

Auf die Frage, was konkret zu tun ist nach der Sperrung von Accounts, zieht sich als Antwort der Aufruf zur finanziellen Unterstützung über Spendenkonten und Crowdfunding-Plattformen wie ein roter Faden durch die Kommunikationskanäle (Abbildung 9). Über ein Drittel der Posts thematisieren, wie sehr die Sperrungen die finanziellen Ressourcen beanspruchen, und rufen zu Spenden auf. (Studie IDZ, S. 44)

Was alle gesperrten Akteure gemeinsam haben, ist die Inszenierung als Opfer von „Zensur“ durch vermeintlich diktatorische Unrechtsregime – und das können wahlweise Staaten oder eben Firmen von sogenannten Herrschaftseliten sein, die in einem „digitalen Gulag“ gegen den unbeugsamen, unbequemen Widerstand der erleuchteten Kämpfer von der rechten Seite vorgehen. Oder wie es die FPÖ in einer Presseaussendung zur Löschung von Kickls Rede auf YouTube ausdrückte: „Der Online-Gigant Google hat auf seiner Videoplattform YouTube den nächsten Anschlag auf die parlamentarische Redefreiheit verübt.“ Dass Kickl seinen Unsinn im Parlament frei verbreiten konnte, spielt in der FPÖ keine Rolle: YouTube weg, parlamentarische Redefreiheit weg.

Mag sein, dass die nach der Sperre prompt folgende breite Opferinszenierung der FPÖ bzw. Kickl kurzfristig geholfen hat, konsequente und dauerhafte Sperren vermindern jedenfalls auch die Reichweite des Zensurgeschreis. Die seinerzeit mächtigste Schmutzschleuder der FPÖ via Social Media, die Facebook-Seite von Heinz-Christian Strache, wurde zwar letztlich Opfer der eigenen parteiinternen Streiterei, aber ihr Verschwinden zeigt nicht nur, dass der FPÖ hier eine große Propagandaplattform verloren gegangen ist, sondern auch, wie kurz das Ablaufdatum einer großen Aufregung sein kann: Heute kräht kein Hahn mehr danach.

Fraglos bedarf es eines genauen Augenmaßes und einer guten Rechtfertigung, um Löschungen durchzuführen. Allerdings ist jeder Akt der Löschung auch ein Signal an eine breitere Gemeinschaft. Schließlich stärkt es Online-Communitys, wenn einflussreichen Hassgruppen der Sauerstoff genommen wird. So zeigen Studien zur Löschung von Hass-Communitys auf dem sozialen Netzwerk Reddit, dass auch in anderen Ecken der Plattform Hassposts sinken, wenn normative Grenzen festgelegt und toxische Inhalte gebannt werden (Chandrasekharan et al. 2017). Somit hat die Löschung einzelner Akteure weit über die gesperrten Accounts Auswirkungen auf die Plattformkultur und bedarf einer gründlichen Dokumentation, um künftigen Fällen besser zu begegnen. (Studie IDZ, S. 60)

Video der digitalen Tagung zur Studie „Hate not found”

1 Das-digitale-Verstummen-von-Donald-Trump (kleinezeitung.at)

2 Sellner: Telegram: 57.005 (lt. IDZ Nov. 2020) nun 58.998 (15.1.21); BitChute 16.358 (lt. IDZ Nov. 20) nun 17.539 (15.1.21); DLive 10.220 (15.1.21).

Die von Rechten und Rechtsextremen durchsetzte Twitter-Alternative „Parler“ wurde nach dem Sturm aufs Kapitol als App sowohl von Google als auch von Apple aus deren Stores entfernt, und der Webhoster Amazon Web Services zeigte Parler ebenfalls die rote Karte. Sellner hatte dort etwa 5.500 Follower.

Unabhängige Recherche ermöglichen...

Jetzt unterstützen »